Rastreamento da Web vs. Extração de Dados da Web: A Diferença Essencial

Adélia Cruz

Neural Network Developer

TL;DR: O web crawling é o processo de descoberta e indexação de páginas da web seguindo links, utilizado principalmente por motores de busca e para auditorias de sites. O web scraping é a extração direcionada de dados específicos dessas páginas descobertas, essencial para pesquisas de mercado e análise de dados. Ambos os processos, especialmente o web scraping, são frequentemente interrompidos por controles de acesso avançados, como o AWS WAF. Esses desafios podem ser resolvidos efetivamente usando uma solução especializada como a CapSolver.

Introdução

O mundo digital é construído sobre dados, e os processos de web crawling e web scraping são os mecanismos fundamentais para coletar essa vasta informação. Embora frequentemente usados de forma intercambiável, eles representam duas etapas distintas, mas complementares, na pipeline de aquisição de dados. Compreender a diferença entre web crawling e web scraping é crucial para qualquer pessoa que esteja construindo aplicações baseadas em dados, realizando pesquisas de mercado ou otimizando para motores de busca.

Este guia completo é destinado a cientistas de dados, especialistas em SEO e desenvolvedores. Definiremos claramente cada processo, destacaremos suas diferenças principais, exploraremos 10 soluções detalhadas em que são aplicadas e demonstraremos como ferramentas como a CapSolver podem ajudar a melhorar a eficiência e resolver desafios comuns de acesso. Ao final, você terá um framework sólido para implementar estratégias eficientes e compatíveis com dados da web.

Web Crawling vs. Web Scraping: A Distinção Principal

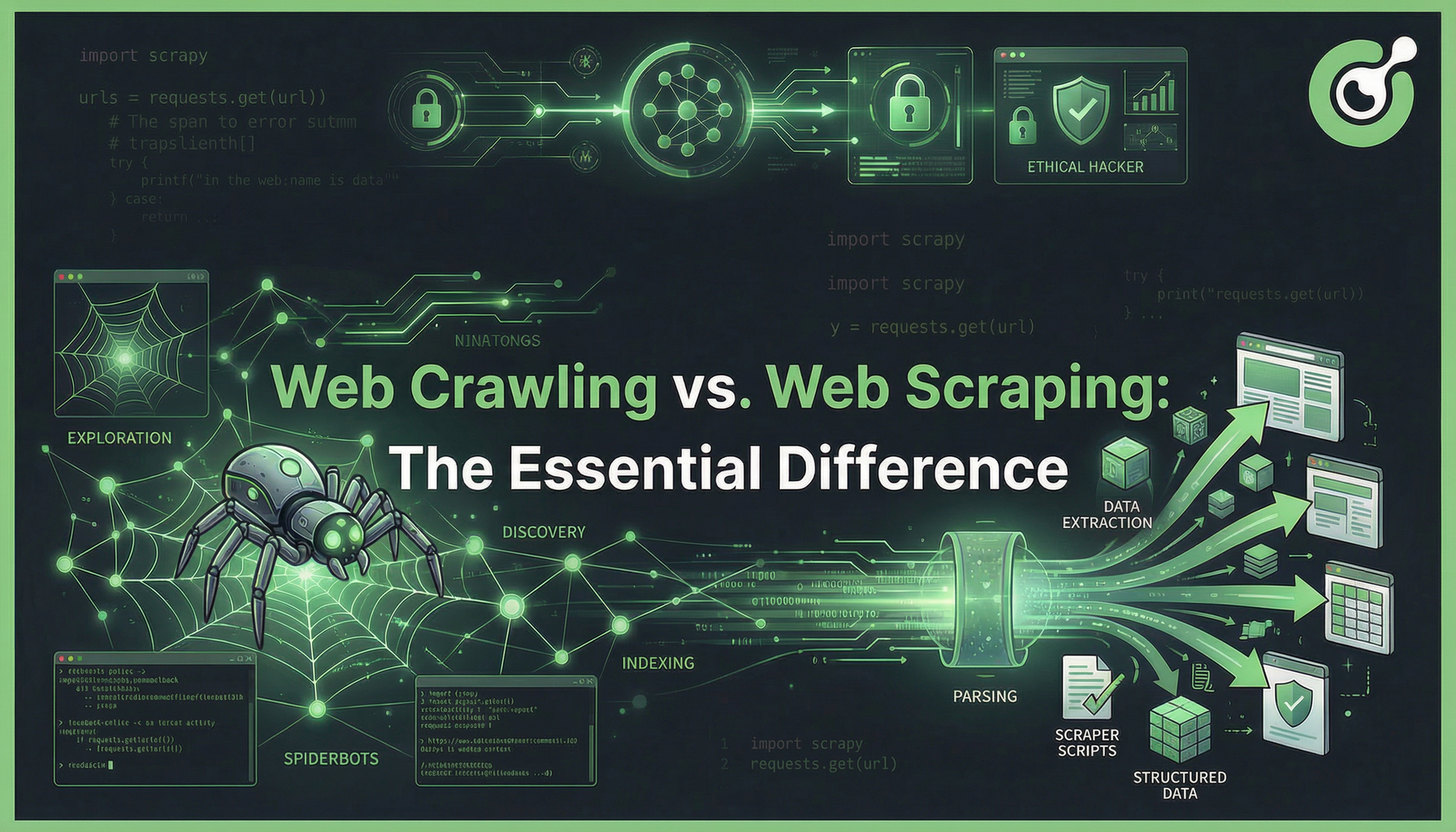

No núcleo, a diferença entre web crawling e web scraping reside em seus objetivos principais. O web crawling é sobre descoberta e mapeamento, enquanto o web scraping é sobre extração e estruturação.

Um web crawler, como o Googlebot, navega sistematicamente pela Web, seguindo hiperlinks de uma página para outra. Seu objetivo é criar um índice completo da internet. Um web scraper, por outro lado, busca pontos de dados específicos—como preços de produtos, informações de contato ou texto de artigos—de um conjunto conhecido de URLs, transformando HTML não estruturado em formatos de dados limpos e utilizáveis, como CSV ou JSON.

Resumo da Comparação: Crawling vs. Scraping

| Funcionalidade | Web Crawling | Web Scraping |

|---|---|---|

| Objetivo Principal | Descoberta, Indexação, Mapeamento da Estrutura do Site | Extração de Dados, Estruturação, Análise |

| Saída | Uma lista de URLs, mapa do site ou índice de páginas | Dados estruturados (JSON, CSV, registros de banco de dados) |

| Escopo | Nível de site ou web (seguido de todos os links) | Nível de página (alvo de elementos específicos) |

| Analogia | Um bibliotecário catalogando todos os livros de uma biblioteca | Um pesquisador extraíndo uma citação específica de um livro |

| Ferramentas Principais | Scrapy, Apache Nutch, Googlebot | BeautifulSoup, Puppeteer, Selenium, Scripts Personalizados |

| Caso de Uso Típico | Otimização de Motores de Busca (SEO), Auditorias de Site | Monitoramento de Preços, Geração de Leads, Pesquisa de Mercado |

Web Crawling: O Motor de Descoberta

Web crawling é o processo automatizado de navegar sistematicamente pela World Wide Web. É o passo fundamental para que os motores de busca descubram novos e atualizados conteúdos.

Propósito e Mecanismo

O propósito principal do web crawling é criar um mapa da internet ou de um site específico. Um crawler começa com uma lista inicial de URLs, busca o conteúdo dessas páginas e depois analisa o HTML para encontrar novos hiperlinks. Ele repete esse processo recursivamente, expandindo sua alcance. Esse processo é regido por regras definidas no arquivo robots.txt, que determina quais partes de um site o crawler pode acessar.

Para profissionais de SEO, o crawling é essencial. Um crawl bem-sucedido significa que uma página pode ser indexada e classificada. De acordo com um estudo sobre a importância do SEO, um crawl bem-sucedido é o primeiro passo fundamental para alcançar visibilidade orgânica. ClickGuard observa que, se uma página não for rastreada, ela não pode ser classificada.

Ferramentas Principais para Web Crawling

- Scrapy: Um framework de rastreamento e extração de dados para Python, rápido e de alto nível. Ideal para projetos de rastreamento em larga escala e complexos.

- Apache Nutch: Um crawler de web de código aberto que pode ser usado para construir motores de busca em larga escala.

- Crawlers Personalizados: Criados usando bibliotecas como

requestseBeautifulSoupem Python, frequentemente usados para tarefas menores e altamente personalizadas.

Web Scraping: A Arte da Extração de Dados

Web scraping é a técnica de extrair dados específicos de sites. É um processo mais focado que ocorre após uma página ser descoberta por um crawler ou quando a URL já é conhecida.

Propósito e Mecanismo

O objetivo do web scraping é transformar dados legíveis para humanos em formatos estruturados e legíveis para máquinas. Isso envolve o uso de seletores (como seletores CSS ou XPath) para localizar os elementos exatos de dados—como o nome de um produto, o preço ou a nota de uma avaliação—ando depois extrair e limpar esse texto.

O mercado de web scraping está experimentando um crescimento significativo. O mercado global de web scraping deve atingir US$ 2,00 bilhões até 2030, impulsionado pela crescente demanda por fontes alternativas de dados em finanças, comércio eletrônico e inteligência de mercado. Mordor Intelligence destaca essa expansão acelerada.

Ferramentas Principais para Web Scraping

- BeautifulSoup: Uma biblioteca Python para analisar documentos HTML e XML, frequentemente usada em conjunto com a biblioteca

requests. - Selenium/Puppeteer: Ferramentas de automação de navegador usadas para extrair conteúdo dinâmico (páginas renderizadas por JavaScript) simulando a interação de um usuário real.

- APIs de Extração Especializadas: Serviços que lidam com a infraestrutura, rotação de proxies e superação de anti-bot para o usuário.

10 Soluções e Casos de Uso Detalhados para Crawling e Scraping

Dominar tanto o web crawling quanto o web scraping permite a criação de soluções poderosas e baseadas em dados. Aqui estão 10 aplicações detalhadas, demonstrando a sinergia entre descoberta e extração.

1. Auditorias Completas de SEO (Crawling)

Objetivo: Identificar links quebrados, cadeias de redirecionamento e problemas de estrutura de site que dificultam o indexamento por motores de busca.

Processo: Um crawler começa na homepage e segue todos os links internos. Ele registra o código de status (200, 404, 301), o título da página e a profundidade de cada URL.

Valor: Garante que todas as páginas importantes sejam descobertas pelos crawlers de motores de busca, o que é fundamental para um bom SEO.

2. Monitoramento de Preços em Tempo Real no E-commerce (Scraping)

Objetivo: Rastrear preços de concorrentes para milhares de produtos para ajustar estratégias de preços dinâmicos.

Processo: Um scraper recebe uma lista de URLs de produtos conhecidos. Ele alvo o elemento HTML específico que contém o preço e extrai o valor numérico.

Valor: Fornece vantagem competitiva permitindo reação imediata às mudanças do mercado.

3. Geração de Leads e Aquisição de Dados de Contato (Scraping)

Objetivo: Extrair detalhes de contato (e-mail, número de telefone) de diretórios de empresas ou sites de networking profissional.

Processo: Um crawler primeiro descobre páginas de perfis de empresas relevantes. O scraper depois extrai os padrões de texto correspondentes a endereços de e-mail e números de telefone dessas páginas.

Valor: Alimenta as linhas de vendas e marketing com informações de contato frescas e direcionadas.

4. Indexação e Classificação de Motores de Busca (Crawling)

Objetivo: A função principal de grandes motores de busca como Google e Bing.

Processo: Crawladores distribuídos e em larga escala descobrem continuamente novos conteúdos. As páginas descobertas são passadas para um indexador, que processa o texto e as armazena em um banco de dados massivo para recuperação rápida.

Valor: Torna a vastidão da internet pesquisável para bilhões de usuários.

5. Agregação de Conteúdo e Feeds de Notícias (Crawling e Scraping)

Objetivo: Criar uma plataforma centralizada que colete artigos de várias fontes de notícias.

Processo: Um crawler monitora os sitemaps e páginas de categorias dos sites de notícias alvo. Quando um novo URL de artigo é encontrado, um scraper extrai o título do artigo, o texto do corpo, o autor e a data de publicação.

Valor: Alimenta leitores de notícias personalizados e plataformas de análise de conteúdo.

6. Pesquisa de Mercado e Análise de Sentimento (Scraping)

Objetivo: Coletar avaliações e comentários de clientes de fóruns, redes sociais e sites de comércio eletrônico para medir a opinião pública sobre um produto.

Processo: Scrapeadores alvo as seções de avaliações de páginas de produtos, extraem o texto e as notas de estrelas. Esse dados é depois alimentado em modelos de processamento de linguagem natural (NLP) para pontuação de sentimento.

Valor: Fornece insights ação sobre forças e fraquezas de um produto diretamente da voz do consumidor.

7. Detecção de Alterações em Sites (Crawling e Scraping)

Objetivo: Monitorar um conjunto específico de páginas para alterações não autorizadas, atualizações regulatórias ou disponibilidade de estoque.

Processo: Um crawler visita a URL alvo em um cronograma. Um scraper extrai um hash do conteúdo principal da página. Se o hash mudar, um alerta é acionado.

Valor: Essencial para conformidade, inteligência competitiva e rastreamento de estoque.

8. Pesquisa Acadêmica e Mapeamento de Citações (Crawling)

Objetivo: Mapear a rede de citações dentro de um campo de estudo.

Processo: Um crawler começa com um artigo-chave e extrai todas as referências e os artigos que o citam. Ele segue esses links para construir um gráfico de influência acadêmica.

Valor: Ajuda pesquisadores a identificar autores-chave e tendências emergentes em seu domínio.

9. Migração de Dados e Arquivamento (Scraping)

Objetivo: Extrair todo o conteúdo de um site antigo antes de desativá-lo, ou arquivar um site para fins históricos.

Processo: Um crawler identifica todas as URLs do site antigo. Um scraper extrai sistematicamente o conteúdo HTML completo de cada página e o salva localmente.

Valor: Preserva dados e conteúdo valioso durante transições de plataforma.

10. Treinamento de Modelos de Aprendizado de Máquina (Scraping)

Objetivo: Adquirir grandes conjuntos de dados diversificados para treinar modelos de IA, como reconhecimento de imagens ou modelos de linguagem.

Processo: Scrapeadores são implantados para coletar milhões de imagens com suas legendas, ou vastas quantidades de dados de texto de diversas fontes.

Valor: Fornece o combustível necessário para desenvolver e aprimorar tecnologias de IA de ponta.

O Desafio: Controles de Acesso Modernos e AWS WAF

À medida que o valor dos dados da web continua a crescer, os sites adotam mecanismos de segurança e filtragem de tráfego cada vez mais avançados. Isso inclui limitação de taxa, verificação de reputação de IP e verificação CAPTCHA, frequentemente implementados por Firewalls de Aplicações Web (WAFs) como o AWS WAF. Sob esses controles, tanto o rastreamento em larga escala quanto a extração seletiva de dados podem ser marcados como comportamento anormal, resultando em solicitações bloqueadas ou em fluxos de dados interrompidos.

Quando o tráfego é suspeito de ser automatizado, o AWS WAF pode emitir um desafio CAPTCHA, parando o fluxo de trabalho até que ele seja resolvido. Nesses cenários, soluções dedicadas tornam-se essenciais para manter a continuidade e a confiabilidade dos dados.

CapSolver: A Ferramenta Essencial para Aquisição de Dados Ininterrupta

A CapSolver é um serviço de superação de CAPTCHA e anti-bot baseado em IA que garante que suas operações de web crawling e web scraping sejam contínuas e eficientes, mesmo contra defesas mais difíceis como o AWS WAF. Ela atua como uma camada crítica, resolvendo desafios em tempo real para que seus crawlers e scrapers possam prosseguir sem interrupções.

A CapSolver oferece soluções baseadas em token e reconhecimento para o AWS WAF, permitindo que os desenvolvedores integrem diretamente ao seus frameworks de scraping Python ou Node.js existentes.

Resgate seu Código de Bônus da CapSolver

Aumente seu orçamento de automação instantaneamente!

Use o código de bônus CAPN ao recarregar sua conta da CapSolver para obter um bônus de 5% adicional em cada recarga — sem limites.

Resgate-o agora em seu Painel da CapSolver

.

Integração da CapSolver para Bypass do AWS WAF

Para demonstrar o poder da CapSolver, aqui está como você integraria para resolver um desafio do AWS WAF usando os modos de reconhecimento e token.

Solução 1: Modo de Reconhecimento do AWS WAF (CAPTCHA Baseado em Imagem)

Este modo é usado quando o WAF apresenta um desafio visual (ex.: "Selecione todas as imagens com um carro).

Etapas de Operação do Código (Exemplo em Python):

- Capturar: Seu scraper detecta o desafio de CAPTCHA do AWS WAF e captura a imagem.

- Enviar: Envie a imagem para a API da CapSolver usando o tipo de tarefa

AwsWafClassification. - Receber: A IA da CapSolver retorna as coordenadas ou rótulos dos objetos corretos.

- Resolver: Seu scraper usa as coordenadas para simular os cliques corretos na página do desafio.

Referência da Tarefa da CapSolver (Modo de Reconhecimento):

Para parâmetros e implementação detalhados da API, consulte a documentação oficial: Classificação do AWS WAF da CapSolver

Solução 2: Modo de Token do AWS WAF (Invisível/Página de Desafio)

Este modo é usado quando o WAF exige um token válido para prosseguir, frequentemente após uma tela de carregamento breve ou uma verificação invisível.

Etapas de Operação do Código (Exemplo em Python):

- Identificar: Seu scraper identifica os parâmetros necessários da página de desafio (ex.:

host,iv,key,context). - Enviar: Envie esses parâmetros para a API da CapSolver usando o tipo de tarefa

AwsWaf. - Receber: A CapSolver resolve o desafio e retorna um

tokenválido. - Bypass: Seu scraper injeta o token recebido nos cabeçalhos ou nos dados do formulário da próxima solicitação para burlar o WAF.

Referência da Tarefa da CapSolver (Modo de Token):

Para parâmetros e implementação detalhados da API, consulte a documentação oficial: Token do AWS WAF da CapSolver

Conclusão e Chamada para Ação

A distinção entre web crawling e web scraping é clara: o crawling é o mapa, e o scraping é o tesouro. Ambos são indispensáveis para estratégias modernas de dados, seja você um especialista em SEO garantindo descobribilidade ou um cientista de dados construindo uma plataforma de inteligência de mercado.

No entanto, o uso crescente de sistemas anti-bot avançados como o AWS WAF significa que até mesmo os fluxos de crawling e scraping mais bem projetados podem falhar. Para manter alta disponibilidade e precisão dos dados, você precisa de uma solução confiável.

CapSolver fornece a camada essencial de defesa contra esses desafios, garantindo que seu fluxo de dados permaneça ininterrupto. Pare de perder tempo resolvendo CAPTCHA manualmente ou lidando com banimentos de IP.

Pronto para construir uma pipeline de dados robusta e ininterrupta?

- Inicie sua jornada: Visite o site da CapSolver para explorar todas as suas soluções anti-bot.

- Comece imediatamente: Registre-se para sua versão gratuita no Painel da CapSolver.

Site Oficial da CapSolver

Painel da CapSolver

Perguntas Frequentes (FAQ)

Q1: O web crawling ou web scraping é ilegal?

Nem o web crawling nem o web scraping são intrinsecamente ilegais. A legalidade depende de o que você escaneia e como você o faz. Você deve respeitar o arquivo robots.txt, evitar escanear dados privados ou protegidos por direitos autorais e seguir os termos de serviço. Escaneamento excessivo ou agressivo que prejudique o desempenho de um site pode ser considerado ilegal ou antiético.

Q2: É possível fazer web scraping sem web crawling?

Sim, é possível. Se você já tiver uma lista de URLs específicas (por exemplo, uma lista de páginas de produtos de um banco de dados), pode realizar o web scraping diretamente nesses páginas sem precisar primeiro fazer o web crawling do site inteiro para descobri-las. O crawling é necessário apenas para descoberta.

Q3: Como a CapSolver ajuda tanto no web crawling quanto no web scraping?

A CapSolver desempenha um papel crucial na resolução de desafios de acesso que interrompem ambos os fluxos de trabalho. Em grandes escaneamentos, o volume elevado de solicitações pode acionar a verificação de CAPTCHA devido ao limite de taxa. Em escaneamentos direcionados, uma tentativa de extração pode acionar um desafio do AWS WAF. A CapSolver processa essas verificações em tempo real, permitindo a continuação suave da fase de descoberta (crawling) e da fase de extração (scraping) sem interrupções.

Q4: Qual é a principal diferença entre um scraper simples e um framework de crawler completo como o Scrapy?

Um scraper simples (por exemplo, usando requests e BeautifulSoup) é normalmente um único script projetado para extrair dados de uma única página ou de uma pequena lista conhecida de URLs. Um framework de crawler completo como o Scrapy é projetado para web crawling em grande escala, distribuído. Ele lida com descoberta de links, agendamento de solicitações, repetições, rotação de proxies e gerenciamento de pipelines, sendo adequado para mapear sites inteiros.

Q5: O web crawling é apenas para mecanismos de busca?

Não. Embora os mecanismos de busca sejam os usuários mais famosos do web crawling, ele também é usado por ferramentas de SEO para auditorias de sites, por pesquisadores acadêmicos para mapear redes de citações e por agregadores de conteúdo para descobrir novos artigos. Qualquer tarefa que exija a descoberta sistemática de links e páginas se beneficia do web crawling.

Ver mais

web scrapingApr 22, 2026

Arquitetura de Web Scraping em Rust para Extração de Dados Escalável

Aprenda arquitetura de raspagem web escalável em Rust com reqwest, scraper, raspagem assíncrona, raspagem de navegador headless, rotação de proxies e tratamento de CAPTCHA compatível.

web scrapingApr 08, 2026

Selenium vs Puppeteer para Resolução de CAPTCHA: Comparação de Desempenho e Caso de Uso

Compare o Selenium vs Puppeteer para resolver CAPTCHA. Descubra benchmarks de desempenho, notas de estabilidade e como integrar o CapSolver para o máximo de sucesso.